Comprereste mai una macchina a guida autonoma che in qualche riga del suo algoritmo abbia scritto di uccidere il “pilota-passeggero” per salvere dei pedoni? La risposta è facile, ovvio, ma il concetto di “male minore” è alla base del funzionamento della self driving car che viaggia seguendo un codice di comportamento ben preciso.

IL DOSSIER L’auto senza pilota

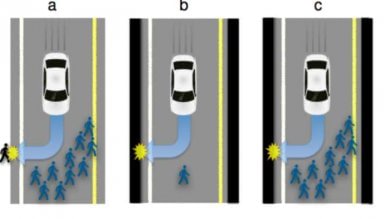

La “scelta” della macchina sarebbe quindi inevitabile se di colpo si trovasse davanti un gruppo di pedoni sbucati all’improvviso da un’uscita laterale: sterzerebbe all’improvviso – ferendo gravemente o uccidendo – il suo unico occupante per salvare il gruppo. La manova, va detto, incosapevolmente la compiono tutti gli automobilisti, che spesso muoiono solo per evitare una busta di plastica o un animale che attraversa. Nelle scuole di pilotaggio insegnano a non deviare la traiettoria quando ci si trova davanti un cane o un ostacolo improvviso piccolo: quasi sempre si finirebbe per morire entrambi. Ma è una manovra difficile, contro natura. Perché l’istinto dice di sterzare di colpo. L’istinto… E se invece la sterzata suicida (che porterebbe alla morte quasi certa del pilota) per salvare i il gruppo di pedoni, è già scritta nel codice di funzionamento dell’auto?

Il problema è stato affrontato da un team di ricercatori guidato da Jean-Francois Bonnefon della Toulouse School of Economics . E ne è uscito un quadro drammatico, che complica ulterioremente le cose: secondo i ricercatori infatti questo tipo di incidenti – dove l’auto “sceglierà” chi ammazzare – saranno inevitabili con l’aumento della diffusione dei veicoli senza pilota

“Si tratta di una sfida formidabile per definire gli algoritmi che guideranno gli AVs (veicoli autonomi) di fronte a questi dilemmi morali”, hanno scritto i ricercatori. “Noi sosteniamo che per raggiungere questi obiettivi, i produttori e le autorità dovranno fare approfonditi studi psicologici per una soluzione etica in incidenti che coinvolgono AVs”,

Nel loro documento i ricercatori hanno intervistato diverse centinaia di persone su di Amazon Mechanical Turk, uno strumento di crowdsourcing on-line. E quando hanno presentato ai partecipanti una serie di scenari, (tra cui quello di scegliere se far morire il pilota o un gruppo di persone), le risposte sono state scontate: tutti si sono detti disponibili a sacrificare la vita del conducente per salvare il gruppo, a patto di non trovarsi loro stessi al volante…

Insomma, Ok al concetto di base che vede le auto a guida autonoma programmate per ridurre al minimo numero di vittime di un incidente, a patto di non trovarsi in auto. Il che pone un altro aspetto fondamentale: nessuno comprerebbe mai una macchina programmata per ucciderci, sia pure per raggiungere un “bene superiore”

Sul tema si è anche espresso il MIT Technology Review che pone un nuovo dilemma. “Se poche persone acquistano automobili senza pilota perché programmate per sacrificare i loro proprietari, poi sempre più persone rischieranno di morire perché le auto normali hanno molti più incidenti di quelle a guida autonoma”. Il classico cane che si morde la coda…