oltre il caso Renzi

Il video manipolato su Matteo Renzi è solo l’ultimo caso di una pericolosa tendenza che corre dall’intelligenza artificiale che modifica un video fino all’alterazione in diretta di un’immagine online. Sono moltissimi i modi in cui l’informazione digitale viene manipolata. Un problema sempre più pressante che va combattuto con la tecnologia, la legge e la cultura

di Vittorio Carlini

25 settembre 2019

8′ di lettura

«Fake news», notizie false. Se ne parla molto in questi giorni per via del video manipolato su Matteo Renzi. In particolare con riferimento ad Internet e al ruolo centrale recitato dai social network quale fonte d’informazione. Un contesto problematico se, come sottolinea CBInsights, circa il 52% del traffico online (soprattutto nelle piattaforme social) è generato da Bots. Cioè software in rete costruiti ad hoc per fingersi esseri umani. Al di là di ciò una domanda è d’obbligo: come vengono costruite le notizie false?

È la stessa CBInsights che, in un report, fornisce una descrizione di alcune tra le più interessanti catene di montaggio della “Fabbrica” delle “fake news”. Una di queste riguarda i video. Immagini di importanti personaggi, ad esempio politici, che potrebbero essere manipolati.

Una mistificazione potenzialmente da usare per screditare lo stesso leader (magari durante una campagna elettorale). Oppure per creare tensioni diplomatiche e incidere sulle decisioni geo-politiche di un Governo.

Così lavora l’Artificial intelligence

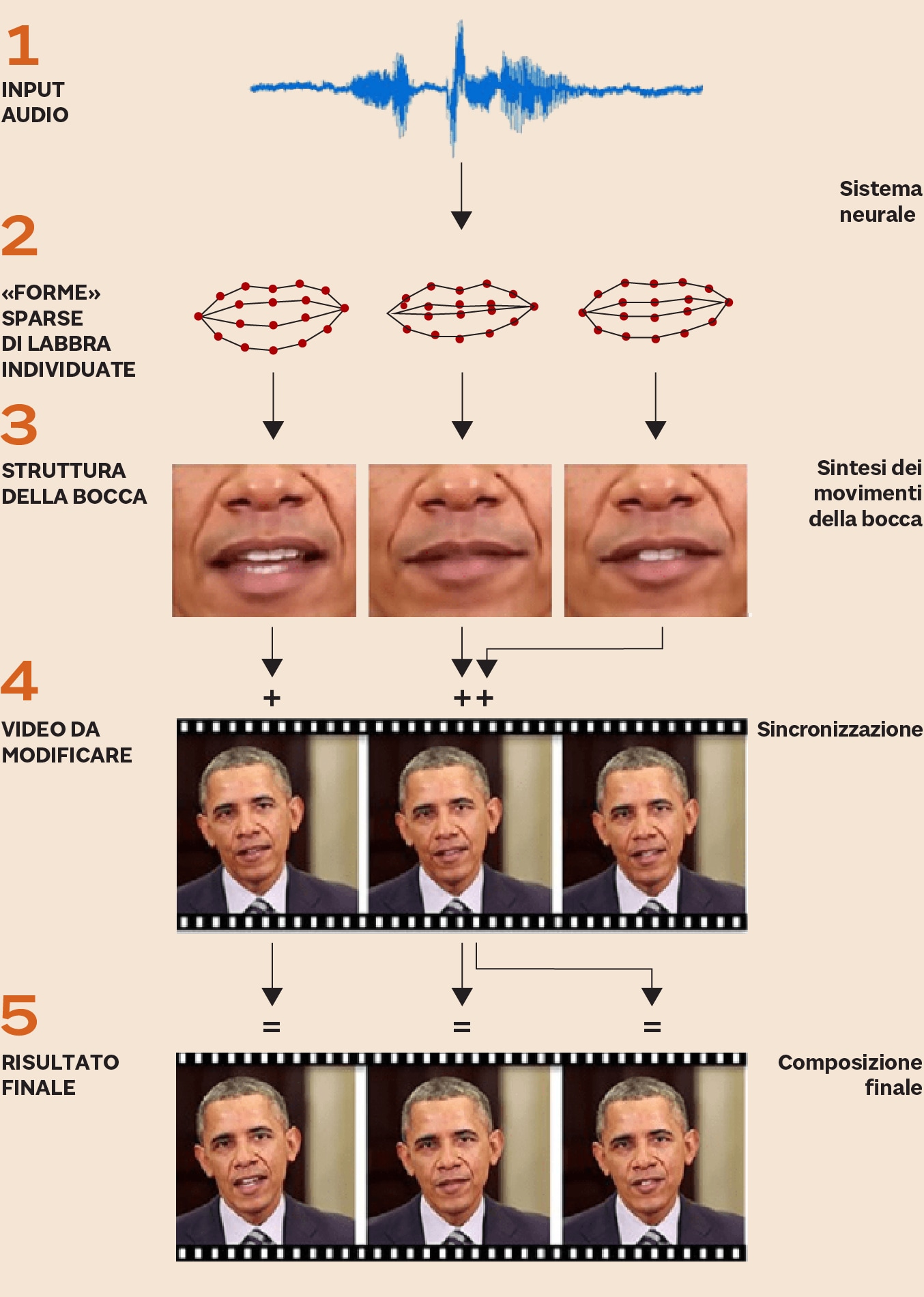

Così CBInsights sottolinea una ricerca effettuata da alcuni scienziati dell’Università di Washington. Gli esperti hanno dapprima preso un file audio di Barack Obama. Successivamente, utilizzando un sistema neurale, hanno individuato, attraverso l’analisi di milioni di immagini dell’ex presidente degli Stati Uniti, diverse forme e posizioni casuali della sua bocca e dei suoi movimenti. Poi l’artificial intelligence (Ai) ha definito la corretta sequenza delle posizioni che si adattava al file audio. Successivamente il filmato “costruito” della parte inferiore della faccia di Obama è stato sintetizzato all’interno di un video in cui l’ex inquilino della Casa Bianca diceva tutt’altro. L’Ai è stata in grado non solo di ricomporre i movimenti della bocca ma anche particolari quali, ad esempio, il movimento delle rughe attorno alle labbra oppure al mento. Il risultato finale? Una clip audio-video ad alta definizione in cui Obama pronuncia in maniera assolutamente naturale cose dette in un’altra occasione.

COME SI FALSIFICA UN VIDEO

Fonte: University of Washington

I vantaggi dell’intelligenza artificiale

Può obiettarsi: simili meccanismi, in linea di massima, sono conosciuti da tempo. Dov è la novità? La risposta si articola su di un duplice piano: il primo è quello dell’uso dell’Ia. Il sistema neurale riesce in poco tempo, e con un basso dispendio di energie, a realizzare il video. Nel passato ci sarebbe voluto l’intervento di esperti di post-produzione dei filmati. Non solo. Il lavoro sarebbe stato molto complicato, lungo e noioso. C’ è poi il secondo piano della risposta: quello della precisione. Certo: anche con l’intervento dell’Artificial intelligence rimangono possibili sbavature. E, tuttavia, il livello del nuovo video è di alta qualità. Tanto che è molto, molto difficile (se non impossibile) capire con l’occhio umano che il video è falso.

Così si cambia l’espressione facciale

La situazione, a ben vedere, si ripete in un’altra situazione (guardate il video qui sotto). Vale a dire quella descritta in un interessante esperimento realizzato da alcuni scienziati della Stanford University, dell’University of Erlangen-Nuremberg e del Max Plank Institute for Informatics. In questo caso i ricercatori hanno mostrato come sia possibile, rimanendo nel mondo online, ricostruire in tempo reale un video presente in rete, sfruttando una semplice webcam. In particolare la faccia di un attore, ripreso dalla stessa webcam, è in grado di modificare l’espressione del personaggio nel video. Nella descrizione dell’esperimento gli scienziati hanno sottolineato come la metodologia in oggetto può, ad esempio, avere un impatto positivo nell’uso delle video conferenze. Al di là di ciò, però, il loro esperimento inevitabilmente sottolinea la facilità con cui le immagini possono essere distorte e il rischio connesso a queste metodologie.

I sistemi neurali non supervisionati

Insomma: il mondo delle “fake news” è tra noi. E sarà sempre più difficile contrastarlo. Anche perchè, ricorda sempre CBInsights, l’Intelligenza artificiale, che ha mille risvolti positivi e può dare una grande mano all’uomo (basta pensare alla dignanostica in medicina) ha un suo lato oscuro. È in grado di creare dei contenuti digitali completamente fasulli. Sono i casi in cui vengono, ad esempio, sfruttati sistemi neurali non supervisionati. Cosa si intende? Per rispondere è necessario dapprima ricordare che l’Ai può essere supervisionata oppure no. Nel primo caso, in parole semplici e senza pretesa di esaustività, il “neural network” funziona così. Il sistema, in linea di massima, prevede un’operatività in parallelo e a più livelli.

L’informazione (input) viene immessa nel nodo (neurone simulato) il quale, dopo averla «elaborata», la trasmette ai nodi successivi e in parallelo. Si giunge così a un primo risultato (output) transitorio. Questo viene «passato» al livello superiore dove si ripete il processo. Di livello in livello la rete neurale, in modo autonomo, arriva all’elaborazione finale dell’informazione. Il processo, tuttavia, è per l’appunto supervisionato. L’input iniziale, un dato certo quale l’immagine di un uomo, deve essere coerente con l’output finale: la macchina viene addestrata a “considerare” l’immagine come un uomo. Fino a quando ciò non accade il procedimento viene ripetuto. Vale a dire: c’è la supervisione. Alla fine l’intelligenza artificiale riconoscerà l’uomo, e i percorsi seguiti nell’elaborare gli input saranno stati decisi in autonomia dall’Artificial intelligence (Ai).